摘要: 在分析人臉結構特征的基礎上,通過引入人臉主要器官的結構約束并結合改進的方向梯度直方圖特征和增量SVM, 提出了一種新的人臉跟蹤算法。實驗證明,該算法能夠顯著提高人臉跟蹤過程的穩定性和準確性,并具有良好的實時性能。

關鍵詞: 人臉跟蹤;結構信息;方向梯度直方圖;增量SVM

目標跟蹤是人工智能領域中最重要的核心問題之一,在工農業、娛樂及軍事領域都具有非常重要的應用價值[1]。目前,在目標跟蹤研究中,常用的方法主要分為基于模型的方法和模型無關的方法兩大類。基于模型的方法需要事先對擬跟蹤的目標進行詳細的研究,手工標注大量的樣本并建立目標模型實現對目標的跟蹤。這類方法前期工作量大,跟蹤過程的實時性差,而且難以適應隨機變形的目標,特別是當目標較復雜,難以獲得精確的模型時,這類方法將完全失效。與模型無關的方法一般通過自動提取目標特征和相似度比對實現目標跟蹤過程。該類方法不需要事先知道目標的先驗信息,可以在跟蹤過程中不斷對目標特征進行學習,來改善和豐富對目標的理解。模型無關的方法能夠快速建立目標跟蹤并在線學習以適應目標變化的特點,使其具有更好的應用價值,是目前研究的熱點[2]。

人臉跟蹤是當前目標跟蹤領域研究的一個熱點,其在治安、娛樂、科研等領域具有很大的現實意義。人臉目標介于剛體和柔性體之間,具有以下特點:人臉大致輪廓和內部器官之間結構關系相對穩定;跟蹤過程中內部結構之間的空間位置存在變形,但滿足一定約束;內部結構本身的形狀和大小也可能存在變形。本文通過研究人臉目標的結構及外觀特點,提出了一種新的結合結構約束的人臉跟蹤方法,其基本思想是,為人臉主要的器官(雙眼、嘴)建立獨立的描述和比較模塊,并對器官間的結構約束進行建模,利用結構信息輔助完成目標搜索和評分,最終確定目標位置。實驗證明,該方法進行人臉跟蹤的準確度和穩定性較傳統CamShift等算法有明顯提高,而且具有良好的實時性,具有較高的應用價值。

1 方法

1.1人臉結構約束

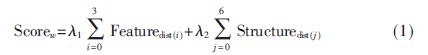

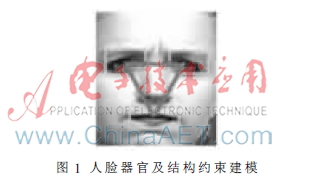

人臉具有典型的結構化特征,通常所謂的“五官”按照規則排列在人臉上,這些器官之間存在明顯的結構約束,但又可以進行較大程度的變形[3-4]。在人臉跟蹤過程中,利用人臉各部分分別建模可以增加特征的穩定性,提高跟蹤的精度[4];同時,引入各結構之間的約束關系,能夠提高人臉跟蹤的適應性,排除誤報。在人臉圖像中,五官中的雙眼、嘴往往具有較大的顯著性,而鼻子、耳朵特征一般較為模糊,特別是在光線、角度不理想的情況下,鼻子、耳朵常不能提供有效的特征。因此,本文以雙眼、嘴共3個面部主要器官為對象,對它們的空間結構約束進行建模。定義評價函數:

其中,Scorew為對于窗口圖像w的評分。等式右邊包括兩部分,第一部分為檢測圖像與目標的特征相似度,本文通過方向梯度直方圖結合SVM獲得;第二部分為目標各模塊之間的結構化約束評分。為了兼顧跟蹤的準確性和實時性要求,這里結構信息采用了雙眼間向量(距離,角度)、嘴部與雙眼間向量(距離,角度)共6個約束形成的三角形作為結構約束,如圖1所示。?姿1、?姿2分別是兩部分的權重因子。人臉跟蹤的過程就是尋找式(1)最小值的過程。

1.2 改進的方向梯度直方圖

方向梯度直方圖HOG(Histogram of Oriented Gradient)特征是一種常用的圖像特征描述子,如圖2所示,由法國國家計算機技術和控制研究所的DALAL N和TRIGGS B在2005年的CVPR上首次提出。由于其對幾何和光學變形具有良好的適應性,HOG特征已經被廣泛應用于計算機視覺和圖像處理中[5]。通過計算和統計圖像局部區域的HOG來構成特征。為了對各模塊進行特征提取并保證系統的實時性,本文根據人臉跟蹤的具體情況對經典HOG算法進行了針對性的優化,方法如下。

(1)對輸入圖像進行顏色空間的標準化(Gamma校正法),以降低圖像局部的陰影和光照變化所造成的影響。

(2)獲取滑動窗圖像并灰度化,將圖像統一為48×64大小的標準圖像。

(3)計算圖像每個像素的方向梯度。

(4)根據跟蹤的目標大小,將圖像劃分成4像素×4像素的方格。

(5)將360°按每個方向45°劃分為8個方向。與經典HOG算法不同,本文根據每個像素的梯度方向,將其幅值線性差值計入與其方向相鄰的兩個方向通道內,統計每個方格的HOG。

(6)將所有方格得到的HOG串聯起來便得到改進的HOG特征。

與經典算法相比,優化的HOG特征簡化了圖像分塊策略,提高了特征計算的速度。同時,由于增加了方向差值過程,使方向梯度的穩定性得到了較大提高,具有更好的抗噪聲性能。實驗證明,在本應用中該特征在提高計算速度的前提下對圖像具有不低于經典HOG算法的表征能力。

1.3 增量SVM

支持向量機(SVM) 是VAPNIK等人提出的一種經典的機器學習方法,由于其優越的學習能力,一經提出就在國內外學術界受到廣泛重視。SVM算法通過使用非線性映射將低維樣本映射到高維空間,并在高維空間使用結構風險最小化理論構建全局最優分割超平面,能夠使整個樣本空間的期望風險以某個概率滿足一定上界[6]。

雖然SVM具有很多優勢,但其經典理論并不具有增量學習的能力,即要求使用者在訓練初期能夠收集一個相對完整的訓練集[7]。對于非模型目標跟蹤來說,在跟蹤初期,對目標的描述和理解往往是片面的,很難獲得完善的訓練集,因此需要在跟蹤過程中對學習機進行不斷的修正。如果使用經典SVM訓練方法,每次增加樣本時,需要對所有原始樣本重新訓練,訓練時間將隨著跟蹤的持續而不斷提升,最終導致不能實時跟蹤。為了解決這一問題,本文將核函數局部化算法引入SVM理論,實現在不顯著增加訓練時間的前提下不斷更新樣本,使SVM分類精度可以隨著跟蹤的進行和樣本集的積累而逐步提高。需要特別指出的是,本文在式(1)中使用的是SVM的特征距離,而非SVM預測標簽。

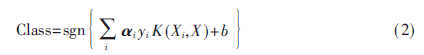

首先按照經典SVM訓練方法得到初始分類器,經典SVM的判別函數一般表示為:

其中,K(·)為核函數,獲得最優超平面f和支持向量集SV。利用核函數的局部特征,當跟蹤到目標得到新的樣本后,驗證KKT條件:

其中,非零?琢i為支持向量。判斷新樣本是否能被超平面f正確分類,如果新樣本能夠被正確分類,則說明該新樣本在分類內部,此時不需要對分類器進行修正,即可進行下一輪跟蹤;如果不能被正確分類,則需要調整分類器。需要指出的是,當新增樣本違背KKT條件時,原樣本集中非支持向量也可能轉化為支持向量,因此需要由新增樣本得到一個新的SVM來檢驗原始樣本是否違背KKT 條件。最終由所有支持向量與所有違背KKT條件的樣本組合構成新的訓練集,并得到最終的新的SVM。該增量學習方法不僅具有良好的數學基礎,而且僅使用現有樣本中少量的樣本進行重新訓練,大大降低了SVM的訓練時間,提高了系統實時性[6]。

2 結合結構信息的人臉跟蹤算法

綜合以上各部分,本文提出的算法具體流程如下:

(1)獲取第一幀圖像并手動框定人臉及雙眼、嘴部區域,生成初始化樣本集。

(2)提取雙眼、嘴部改進的方向梯度直方圖特征,訓練初始SVM;計算結構約束,初始化結構參數。

(3)取下一幀,搜索雙眼及嘴部候選區域,記錄SVM距離。

(4)在候選區域中尋找最小化式(1)的區域,作為跟蹤結果。

(5)根據跟蹤結果修正結構參數。

(6)每累計跟蹤10幀,利用新的正負樣本(正樣本為跟蹤到的目標,負樣本為搜索過程中獲得的目標周圍的圖像區域)增量更新SVM。

(7)返回到步驟(3),進行下一輪跟蹤。

3 實驗

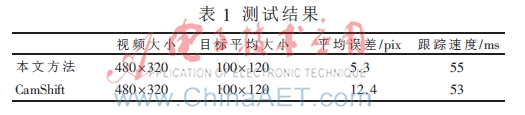

實驗所用的計算機平臺為I3-2120 @3.30 GHz CPU,4 GB內存,操作系統為Windows XP SP3。測試程序在MATLAB 2011b平臺下實現。本文選取了近年來比較著名的電影和電視劇中的片段作為測試對象。在這些片段第1幀用鼠標框取了待跟蹤人臉及其雙眼和嘴部,從第2幀開始進行跟蹤,部分結果如圖3所示。將本文提出的算法與經典CamShift算法相比較,結果如表1所示,可以看出本文算法在跟蹤精度上具有明顯優勢。

本文通過研究人臉的結構特征,對人臉主要器官的結構約束進行建模,并結合改進的HOG與增量SVM,開發出一種新的人臉跟蹤算法。實驗結果表明,本文提出的算法能夠在人臉跟蹤過程中更好地適應目標的角度變化和部分遮擋,跟蹤精度和穩定性優于傳統的CamShift算法,并能夠達到實時性要求。

參考文獻

[1] 馬曉路,劉倩,牟海軍.基于Mean Shift 和粒子濾波的運動目標跟蹤[J].微型機與應用,2012,31(23):42-44.

[2] 張寶峰,趙建平,朱均超. 基于OpenCV的室內環境下多目標跟蹤[J].微型機與應用, 2013,32(9):24-26.

[3] Zhang Lu, Laurens van der Maaten. Structure PreservingObject Tracking[C]. 2013 IEEE Conference on Computer Vision and Pattern Recognition,2013:1838-1845.

[4] BRANSON S, PERONA P, BELONGIE S. Strong superv-ision from weak annotation: interactive training of defor-mable part models[C]. 2011 IEEE International Conference on Computer Vision, 2011:1832-1839.

[5] 王文武, 王華昌. 嵌入式客流量統計模塊的設計和實現[J].電子技術應用,2011,37(8):33-35.

[6] 牛勝石,毛曉暉,侯建華,等.基于Adaboost和SVM的人頭實時檢測[J].微型機與應用,2010,13(1):33-36.

[7] 潘以楨, 胡越明. 改進的在線支持向量機訓練算法[J].計算機工程,2009,35(22):212-215.