上周,英特爾發布采用其10nm工藝的第三代至強可擴展處理器Ice Lake。本周一,被英特爾收購的以色列自動駕駛芯片公司Mobileye宣布與自動駕駛(AV)初創公司Udelv 合作,采用其EyeQ 5芯片和全棧AV系統平臺開發無人駕駛貨運車Transporters。

同樣在本周一,英偉達發布基于Arm架構的數據中心處理器Grace,同時發布自動駕駛(AV)平臺DRIVE Hyperion 8和AV芯片DRIVE Atlan(號稱性能高達1000TOPS)。

在服務器CPU市場,Intel擁有超過90%的份額,AMD霄龍系列服務器CPU始終無法撼動Intel的地位。英偉達與Arm聯合開發的Grace能否對抗英特爾?英偉達最高性能的自動駕駛芯片和平臺能否勝過英特爾旗下的Mobileye?

在全球兩大最高性能計算和最熱門需求的市場上—數據中心和自動駕駛,英偉達開始正面對決英特爾。多年生活在英特爾陰影下的英偉達這次能否與英特爾平分秋色,稱霸全球高性能計算(HPC)市場?在回答這個問題之前,讓我們先看看兩家公司各自的“當家武器”。

英偉達AV平臺Hyperion 8和AV芯片DRIVE Atlan

英偉達CEO黃仁勛在GTU虛擬大會上宣布了DRIVE Atlan,這款計劃2025年量產的下一代DRIVE SoC將提供高達1,000 TOPS的性能,集成有CPU、GPU和深度學習加速器(DLA),并為下一代AV提供最新的網絡和安全性。

Nvidia自動駕駛芯片DRIVE Atlan。(來源: Nvidia)

英偉達同時發布了自動駕駛開發平臺DRIVE Hyperion 8,以及數字孿生仿真工具DRIVE Sim。該公司聲稱已經簽署價值80億美元的汽車合作開發協議,合作伙伴包括沃爾沃汽車、奔馳、蔚來、上汽、TuSimple、Zoox、Cruise、法拉第未來和VinFast等公司傳統車廠及造車新勢力。

DRIVE Hyperion 8 AV平臺可以支持數據采集、AV開發和測試。(來源: Nvidia)

在英偉達發布的所有技術和產品中,EETimes汽車專欄作家和資深汽車行業分析師Egil Juliussen認為Hyperion 8可能是最有價值的。這個AV開發平臺可能吸引更多汽車OEM廠商、自動駕駛初創公司和運輸公司因為它可以極大地簡化AV系統設計流程,并為未來產品的開發鋪平道路。這類似于IC設計行業的開發系統,或者基于AI的自動駕駛行業的云計算平臺。在主題演講中,黃仁勛確實提到了分別與亞馬遜AWS和Google Cloud達成的合作協議。

Drive Atlan展示出英偉達基于GPU持續提升其自動駕駛SoC的一貫做法,但Linley調研公司高級分析師Mike Demler注意到,英偉達似乎越來越早地宣布其未來處理器產品,這難道是讓業界和競爭對手毫無喘息之力嗎?Orin都還沒有量產,他們現在又發布了下一代產品Atlan。Atlan原理圖和1,000 TOPS性能規格可能只是頂層設計目標罷了。

Nvidia的DRIVE SoC規劃圖。(Source: Nvidia)

Mike Demler提出質疑,采用320 TOPS Xavier的Drive Pegasus是L5系統,然后Orin升級到400 TOP,現在Atlan更是躍升至1000 TOPS?英特爾旗下的Mobileye提供的同類AV芯片大約是“ TOPS”性能評級的1/10,而功耗卻低得多,顯然TOPS不是一個可靠的衡量標準。他補充道,贏得奔馳和沃爾沃的設計是很不錯的,但是不到量產階段就毫無意義。

Juliussen也表示認同,1,000 TOPS固然很好,但這幾乎不可能達到。他認為TOPS應該代表極度樂觀的處理器速度(Totally Optimistic Processor Speed),加上功耗才有意義。

Demler還對Atlan的SoC架構提出了質疑,英偉達希望Atlan一顆芯片就能集成儀表盤、信息娛樂、ADAS/AV、駕駛員監控(DMS),以及網絡網關等全部汽車駕駛功能。在英偉達看來,汽車就是有輪子的服務器。但是,與數據中心不同的是,自動駕駛汽車沒有無限的電力供應。現在尚不清楚將所有這些功能都集成在一塊芯片上是否最好的方法,盡管英偉達會推出一系列Atlan芯片。

Mobileye采取系統級AV策略

英偉達如何領先汽車市場?憑借其完善的生態系統(硬件、軟件和AI模型),以及性能不斷提升的SoC。而Mobileye則采取系統級AV策略,其秘密武器是“真正的冗余(true redundancy)”。

與Mobileye合作的AV初創公司Udelv計劃到2028年生產3.5萬輛Transporter無人駕駛貨運車,均采用Mobileye的全棧自動駕駛系統。據Udelv聯合創始人兼CEO Daniel Laury稱,他們最初采用百度的Apollo平臺,但最終還是選擇了Mobileye,主要是看重后者的“冗余自動駕駛”功能,因為這是“真正的冗余”。Mobileye還采用了一種獨特的方法,將傳感器分離為兩個通道-一個用于攝像頭,另一個用于雷達和激光雷達。其理念是讓每個通道獨立地證明各自的安全性,然后在將兩個通道融合。相比之下,競爭對手的方法是部署互補性傳感器,即從一開始就將它們融合在一起,以創建一個單一的模型。

Udelv的Transporter無人駕駛貨運車采用Mobileye全棧自動駕駛系統。(來源: Udelv)

Udelv還喜歡Mobileye“道路體驗管理”(REM)眾包地圖方案,可以支持廣泛的地圖覆蓋范圍。Mobileye聲稱,他們每天可以繪制超過800萬公里的道路,而且已經繪制了將近10億公里的道路。該公司預計到2024年,每天可以繪制100萬公里的地圖。

英特爾至強Xeon處理器通吃云端、網絡和智能邊緣

據英特爾宣傳,與前一代產品相比,最新的第三代至強可擴展處理器在主流數據中心工作負載上性能平均提升46%,同時增加了針對AI加速的深度學習加速技術(DL Boost)。采用10nm工藝的至強可擴展處理器可以加速云端、人工智能、企業端、高性能計算、網絡、安全和邊緣應用上的部署。

英特爾執行副總裁兼數據平臺事業部總經理Navin Shenoy發布第三代英特爾至強可擴展處理器。(來源:Intel)

據英特爾2021年第一季度業績顯示,該處理器出貨量已經超過20萬顆。其中,全球范圍內大型的云服務提供商即將部署服務,在50個獨立OxM合作伙伴中有超過250個基于該處理器的設計,超過20個高性能計算(HPC)實驗室和HPC即服務環境正在利用全新至強可擴展處理器。

英偉達基于 Arm 架構的數據中心 CPU 處理器“Grace”

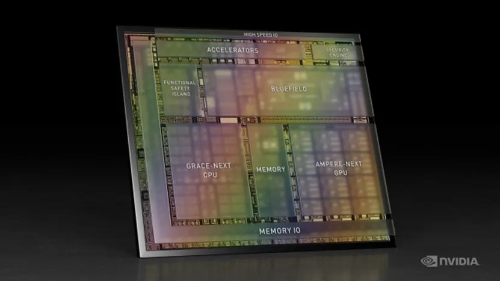

在GTC2021大會上,英偉達 發布其首款基于 Arm 架構的數據中心 CPU 處理器“Grace”,在最復雜的 AI和高性能計算工作負載下,可實現 10 倍于當今最快服務器的超高性能。

分析認為,英偉達此舉是直接挑戰英特爾在服務器和數據中心計算領域的主導地位,因為發布會后,英特爾和AMD的股價應聲下跌了幾個百分點。

為什么要做這款CPU?

英偉達認為,AI模型的數據量和規模正在成倍增長。當今最大的AI模型包括數十億個參數,并且每兩個半月就會翻一番。訓練它們需要一個新的CPU,可以與GPU緊密結合,以消除系統瓶頸。

英偉達創始人兼首席執行官黃仁勛表示,“NVIDIA Grace? CPU 是超過10,000個工程年的成果,專為滿足全球最先進應用的計算要求而設計。”—— 這些應用包括自然語言處理、推薦系統、AI 超級計算 —— 其所進行的海量數據分析需要超高速計算性能和大容量內存。

老黃仍然穿著他標志性的皮衣,在他們家標志性的廚房開著發布會。唯一的變化是頭發長了,有人說“老黃這都是被缺貨給愁的”

Grace這個名字來自美國海軍少將、計算機編程先驅Grace Hopper。她是計算機科學的先驅之一,也是哈佛Mark 1的第一批程序員和第一個鏈接器的發明者。

Grace Hopper在20世紀50年代開創了計算機編程,發明了世界上第一個編譯器,被稱為“計算機軟件工程第一夫人”。

這款CPU產品采用了Arm Neoverse核心,與低功耗內存子系統相結合,以高能效提供高性能。也有人認為,這英偉達是在收購Arm的關鍵時刻,英偉達表達誠意的一款作品。

“前沿的AI和數據科學正推動當今的計算機架構超越其極限,以處理規模難以想象的海量數據。NVIDIA 借助 Arm授權的 IP設計了 Grace,這是一款專為大規模AI和HPC設計的CPU。與GPU和DPU一起, Grace為我們提供了計算的第三種基礎技術,以及為了推進AI發展重構數據中心的能力。NVIDIA現在是一家擁有三種芯片的公司。” 黃仁勛說到。

比 x86 CPU如何?

英偉達在新聞稿中描述,Grace是高度專業化的處理器,工作負載面向例如訓練具有超過1萬億個參數的新一代NLP模型等。當與NVIDIA GPU緊密耦合時,搭載Grace CPU的系統速度比如今基于 NVIDIA DGX ?打造的最先進的系統(在 x86 CPU 上運行)快 10 倍。

在絕大多數數據中心由現有的CPU提供服務的同時,Grace將為計算的細分市場提供服務。

瑞士國家超級計算機中心 (CSCS) 和美國能源部洛斯阿拉莫斯國家實驗室 (Los Alamos National Laboratory) 率先宣布計劃構建搭載Grace的超級計算機,以支持國家科學研究工作。

NVIDIA推出Grace的背景是數據量和 AI 模型規模呈指數級增長。如今最大的 AI 模型包含數十億個參數,并且參數數量每兩個半月就會翻一番。訓練這些模型需要一個與 GPU 緊密耦合的新 CPU,以消除系統瓶頸。

NVIDIA 利用 Arm 數據中心架構極大的靈活性構建了 Grace。通過推出新的服務器級 CPU,NVIDIA正在推進在AI和HPC領域中技術多樣性的目標。在這些領域,更多選擇是實現解決全球最迫切問題所需創新的關鍵。

Arm 首席執行官 Simon Segars 表示:“作為全球授權范圍最廣的處理器架構,Arm 每天正在以不可思議的新方式推動創新。NVIDIA 推出Grace 數據中心 CPU 明確表明Arm的授權模式如何促進一項重要創新,這將進一步支持世界各地 AI 研究人員和科學家們非凡的工作。”

Grace 的首批使用者

CSCS 和洛斯阿拉莫斯國家實驗室計劃將于 2023 年推出由慧與(Hewlett-Packard Enterprise)構建的、搭載Grace的Alps系統。該系統采用新的 HPE Cray EX 超級計算機產品線以及 NVIDIA HGX 超級計算平臺,除了全新的Grace CPU,還包括 NVIDIA GPU 和 NVIDIA HPC SDK 。

CSCS 總監 Thomas Schulthess教授表示:“利用 NVIDIA 全新的 Grace CPU,使得我們能將 AI 技術和傳統的超級計算融合在一起,來解決計算科學領域一些最難的問題。我們很高興能夠向我們的瑞士和全球用戶提供這款全新 NVIDIA CPU,用于處理分析海量和復雜的科學數據集。”

洛斯阿拉莫斯國家實驗室主任 Thom Mason 表示:“通過創新地平衡內存帶寬和容量,新一代系統將重塑我們機構的計算策略。憑借 NVIDIA 全新 Grace CPU,我們可以在比以前更大的數據集上完成高逼真度3D仿真和分析,從而進行先進的科學研究工作。”

Alps 系統是新一代超級計算機中的一員,將取代 CSCS 現有的 Piz Daint 超級計算機。新一代超級計算機利用 GPU 加速的深度學習技術,將超級計算擴展到傳統的建模和模擬領域之外。

Thomas Schulthess 表示:“深度學習只是我們添加到工具箱中的一組功能非常強大的工具而已。”

Alps 利用 NVIDIA CPU 和 GPU 之間的緊密耦合,預計僅需兩天就能訓練出全球最大的自然語言處理模型 GPT-3,比 NVIDIA 的 2.8-AI exaflops Selene 超級計算機快 7 倍。Selene 超級計算機目前被 MLPerf 認定為世界領先的 AI 超級計算機。

CSCS 用戶能夠將這種超強的 AI 性能廣泛地應用到從自然語言理解中獲益的新興科學研究。例如,這包括分析和理解科學論文中提供的海量知識,以及生成用于藥物發現的新分子。

實現性能突破

據英偉達方面資料,Grace基于第四代 NVIDIA NVLink? 互聯技術,該技術在Grace和 NVIDIA GPU 之間提供創紀錄的 900 GB/s 連接速度,使總帶寬比當今領先的服務器高 30 倍。從CPU到CPU的速度超過600GB/s。

Grace 還將利用創新的 LPDDR5x 內存子系統,該子系統的帶寬是 DDR4 內存的兩倍,能效達 DDR4 的 10 倍。此外,新架構提供單一內存地址空間的緩存一致性,將系統和 HBM GPU 內存相結合,以簡化可編程性。

Grace將獲得 NVIDIA HPC軟件開發套件以及全套 CUDA? 和 CUDA-X? 庫的支持,可以對 2,000 多個 GPU 應用程序加速,使得應對全球重大挑戰的科學家和研究人員探索速度更快。